Il calcolo in parallelo del computer quantistico

È difficile avere numeri esatti, ma si stima che nel mondo ci siano più di 2 miliardi di personal computer. Gli smartphone potrebbero essere invece già nell’ordine dei 7 miliardi. Alla base di questo straordinario successo tecnologico e commerciale c’è un’idea semplice, quella che ha permesso la rivoluzione informatica del secolo scorso.

Qualsiasi operazione di calcolo può essere scomposta in una serie precisa di passaggi elementari e la logica di questi passaggi (matematica, astratta) può venire letteralmente materializzata predisponendo adeguatamente dei fili elettrici, degli interruttori e giocando con gli impulsi elettrici nei circuiti così creati.

In linguaggio binario, la presenza di corrente in un filo corrisponde allo stato 1 dell’interruttore, l’assenza di corrente allo stato 0. Colleghiamo due fili a un interruttore: se in entrambi passa corrente otterremo lo stato 1, in tutti gli altri casi (un solo filo ha corrente o nessuno dei due ne ha) avremo lo stato 0. Un simile sistema permette di dar forma a operazioni logiche come la congiunzione (se in input c’è corrente in entrambi i fili, in output ci sarà corrente) o l’implicazione (se → allora).

Ora, chiamiamo quegli interruttori transistor, miniaturizziamo il tutto, creiamo circuiti un po’ più complessi e avremo un microprocessore, come quelli montati nei nostri PC o smartphone. Uniamo un microprocessore all’altro, facciamoli lavorare insieme e avremo la velocità del calcolo parallelo.

In informatica si chiama bit l’unità di informazione di base: l’interruttore di una lampadina misura 1 bit, perché prevede solo due possibili stati: acceso o spento. Ma anche una porta, aperta o chiusa, è un sistema da 1 bit, così come un bicchiere, che può essere o pieno o vuoto. Questi naturalmente sono sistemi macroscopici ed è difficile costruire calcolatori che utilizzino porte di legno o bicchieri di vetro come unità elementari di elaborazione delle informazioni. Meglio restare sui microprocessori elettronici, che funzionano molto bene.

Ma cosa accade se proviamo a costruire sistemi elementari da 1 bit, andando a esplorare dimensioni ancora più piccole di quelle di un microprocessore elettronico? Cosa succede se invece di usare corrente elettrica che passa per microinterruttori, usiamo atomi o particelle come unità fondamentali di elaborazione dell’informazione? Succede che le cose si fanno estremamente complicate ma, potenzialmente, rivoluzionarie.

“Il computer impossibile – come il calcolatore quantistico cambierà il mondo” di Giuliano Benenti, Guido Casati e Simone Montangero (Raffaello Cortina Editore, 2025) conduce per mano il lettore, passo dopo passo, in questo mondo fatto non di bit normali, ma di bit quantistici (quantum bit o qubit).

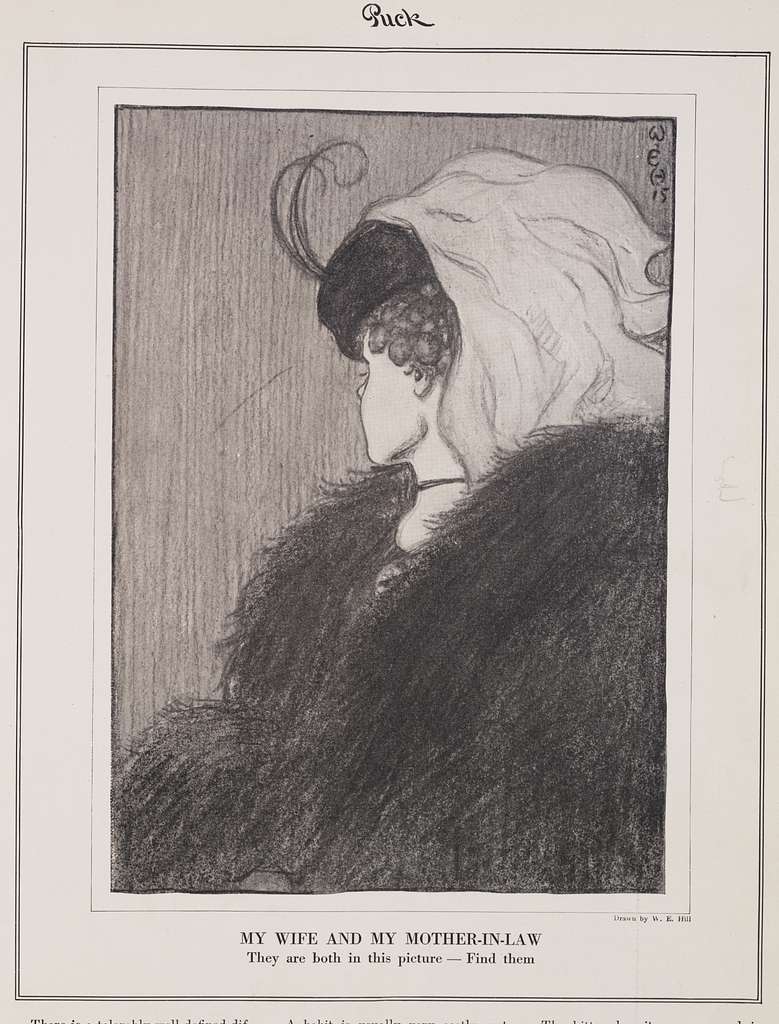

A livello atomico e subatomico infatti non valgono più le regole intuitive della fisica classica: vigono le regole della fisica quantistica e gli oggetti con cui si ha a che fare non sono ben contornati come nel mondo macroscopico. Le particelle vivono in stati di sovrapposizione quantistica, un po’ come l’illustrazione di William Ely Hill, dove la donna è giovane o anziana a seconda di come la si guarda.

Allo stesso modo, non si può conoscere con precisione assoluta, nello stesso istante, la posizione e la velocità di un elettrone. O ancora, certe particelle possono essere correlate l’una con l’altra, in modo che se accade qualcosa a una, accadrà necessariamente qualcosa anche all’altra. E più in generale, la comprensione che abbiamo di questo micromondo non può essere deterministica, ma solo probabilistica.

Provare a utilizzare questi oggetti come unità fondamentali di calcolo può sembrare un’impresa folle, e in parte forse lo è. Ma almeno dagli anni ‘90 ci si è accorti che proprio l’essenza probabilistica di questi fenomeni può essere sfruttata come un naturale sistema di calcolo parallelo.

Se un bit è come una moneta che una volta lanciata può essere 0 o 1, un quantum bit può essere raffigurato, spiegano gli autori del libro, come un mappamondo che gira e noi che puntiamo il dito siamo l’osservatore: l’emisfero nord è 1, l’emisfero sud è 0 e noi avremo una certa probabilità (60-40, 70-30, 20-80) di puntare il dito o sull’emisfero nord o sull’emisfero sud.

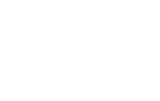

Questa distribuzione di probabilità diventa il sistema di calcolo parallelo del qubit, che metaforicamente è un mappamondo, ma materialmente possono essere degli atomi eccitati (ioni) che tendono a respingersi, ma che vengono tenuti insieme da campi elettrici. L’interazione elettrostatica tra due o più atomi genera quella speciale correlazione quantistica (entanglement) che diventa l’unità fondamentale di calcolo quantistico: il qubit. A questo punto gli ioni vengono manipolati ed eccitati con minuscoli impulsi laser che permettono il corrispettivo quantistico delle operazioni logiche.

Avendo due ioni quantisticamente intrecciati (entangled) se accade qualcosa a uno, accade qualcosa anche all’altro. Se il primo qubit è nello stato 1 (ad esempio se ha un elettrone in un certo orbitale), allora il secondo qubit cambia stato: il suo elettrone passa a un altro orbitale (in termini informatici passa da 0 a 1 o da 1 a 0); se il primo qubit è nello stato 0 (non ha l’elettrone in un certo orbitale) allora il secondo qubit rimane nello stato in cui è (il suo elettrone sta dov’è). Con questo semplice (si fa per dire) sistema, si riesce a implementare la cosiddetta funzione CNOT (controlled-not) che è la più elementare operazione logica del calcolo quantistico, con la quale si possono costruire calcoli ben più complessi.

Siccome il primo qubit, come il mappamondo che gira, ha una certa probabilità di trovarsi o nello stato 0 o nello stato 1 (è in una sovrapposizione di stati), “con due qubit i possibili stati di input con i quali possiamo eseguire simultaneamente un calcolo sono 4 (00, 01, 10, 11), con tre qubit diventano 8 (000, 001, 010, 011, 100, 101, 110, 111) e così via”. Si tratta di una progressione esponenziale, mentre la progressione della potenza informatica classica è lineare: se lancio in aria una moneta ho 1 bit, se ne lancio 2 ho 2 bit, se ne lancio 3 ho 3 bit. In questa differenza risiede il vantaggio quantistico: se un giorno si riuscirà a sfruttarlo a pieno, i calcolatori quantistici saranno in grado di risolvere problemi, in certi settori specifici, che richiederebbero tempi astronomici al più potente computer classico.

Per addomesticare questo vantaggio computazionale però vanno vinte sfide, scientifiche e ingegneristiche, affatto banali. Mantenere intrecciati i qubit per un tempo sufficiente a eseguire le manipolazioni laser che consentono il calcolo è, per usare le parole degli autori, “un’impresa titanica”. È “proprio su questo terreno”, ovvero allungare i cosiddetti tempi di decoerenza, “che si gioca il futuro del calcolo quantistico”.

Un atomo poi è un’entità che definire estremamente sensibile è ancora eufemistico: per evitare che il suo stato venga alterato da perturbazioni esterne occorre farlo lavorare a temperature prossime allo zero assoluto, ovvero -273,15°C.

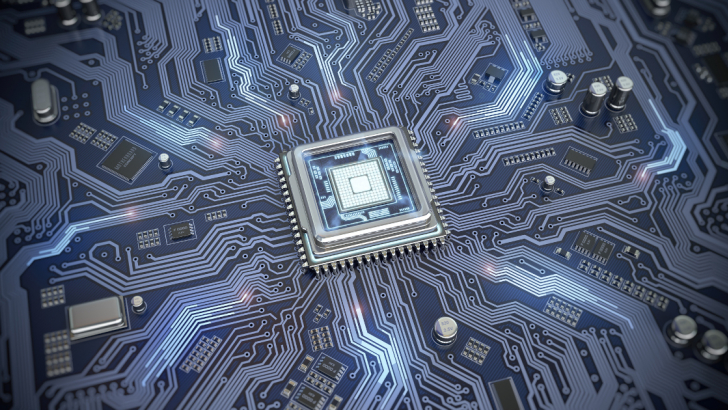

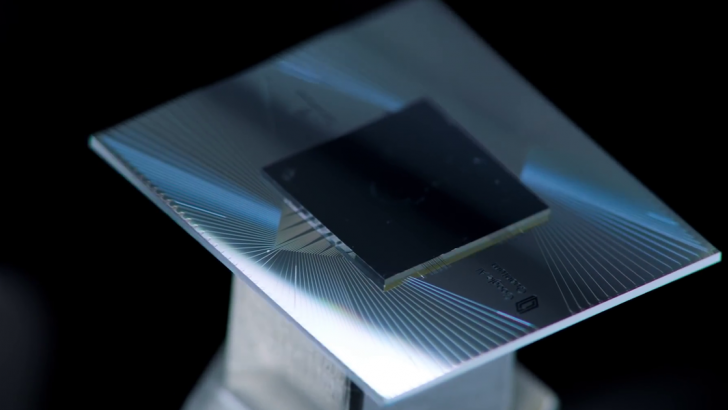

Per questo gli scienziati stanno ancora esplorando quale potrebbe essere l’approccio più promettente al calcolo quantistico. Oltre agli ioni intrappolati, si sta provando a usare come qubit coppie di elettroni entangled che scorrono senza resistenza all’interno di materiali superconduttori. O ancora, si stanno sperimentando qubit formati da atomi neutri, privi di carica elettrica, in cui gli elettroni vengono spinti il più lontano possibile dal nucleo in modo da renderli oggetti più grandi e più facili da maneggiare con le cosiddette pinzette ottiche (dei laser ultra-precisi).

Oltre a questi approcci, si possono creare qubit anche utilizzando le particelle elementari di cui è fatta la luce, ossia i fotoni, che sono anche già considerati l’approccio più promettente in un’altra tecnologia che sfrutta le proprietà della fisica quantistica: le telecomunicazioni quantistiche. Il libro le esplora, con la stessa dovizia di particolari, e lo stesso fa con i sensori quantistici e i simulatori, altre tecnologie che sono già arrivate a uno stadio di sviluppo più avanzato rispetto al calcolo quantistico e che trovano già applicazioni nel mondo reale.

Così come il computer quantistico, anche la lettura di questo libro fa sperimentare al lettore una sorta di calcolo in parallelo, perché per arrivare a comprendere il funzionamento di quella che potrebbe essere una tecnologia chiave del futuro prossimo, chi legge deve elaborare rapidamente nozioni di informatica, di fisica, di matematica, di logica e persino di storia della scienza. Gli autori però non saltano nessun passaggio e lo sforzo ripaga, perché la soddisfazione di trovarsi a dire “adesso ho capito!” è simile a quella di uno studente che di fronte a un problema di matematica trova, alla fine, la soluzione.