Le fake news possono influenzare le elezioni?

A maggio si tornerà a votare per l'elezione dei rappresentanti del nuovo Parlamento europeo e uno degli spettri che si sta allungando sul prossimo appuntamento elettorale è quello delle fake news. Si teme che la fabbricazione di informazioni distorte e la loro diffusione incontrollata attraverso i social network possa manipolare l'opinione pubblica al punto da metter a rischio la liceità del processo democratico.

Facebook ha già annunciato il suo impegno per controllare i contenuti che verranno pubblicati sulla piattaforma per “proteggere l'integrità delle elezioni”, ha dichiarato Anika Geisel per conto dell'azienda di Zuckerberg. Le misure comportano lo sviluppo di strumenti di controllo per prevenire “l'interferenza straniera” nelle elezioni e per rendere più trasparente la pubblicità su Facebook (per pubblicità si intendono anche “post sponsorizzati”, la cui diffusione viene aumentata proporzionalmente al pagamento versato a Facebook). “Sebbene sappiamo che la maggior parte della pubblicità su Facebook è operata da organizzazioni legittime” si legge nel comunicato, “sappiamo che esistono attori cattivi che tentano di usare in modo distorto la nostra piattaforma”.

Here is an update on what Facebook will do to ensure the integrity of the European Parliament Elections https://t.co/Jc3Spfbquf

— Anika Geisel (@anikageisel) 28 gennaio 2019

Il precedente più illustre è quello delle elezioni presidenziali statunitensi del 2016 che videro Donald Trump salire alla Casa Bianca. Lo scandalo scoppiò definitivamente nel marzo 2018 quando The Guardian pubblicò le rivelazioni di Christopher Wylie, collaboratore di Cambridge Analytica (CA). La società, finanziata dal miliardario Robert Mercer, aveva tra i membri del consiglio di amministrazione Steve Bannon, membro del Consiglio per la Sicurezza Nazionale della presidenza Trump fino al 5 aprile 2018. CA si sarebbe occupata anche di altre campagne, tra cui il referendum inglese sulla Brexit. Il ruolo della società sarebbe stato quello di identificare i profili di personalità più inclini a essere persuasi a votare per Trump, per poi bersagliarli con messaggi elettorali estremamente personalizzati e dunque efficaci. Per individuare il target, CA sarebbe entrata in possesso dei dati di utenti Facebook (decine di milioni di persone) in modo illecito e Facebook non avrebbe fatto nulla per impedirglielo. Marck Zuckerberg, ad aprile 2018, fu chiamato di fronte ai membri della Camera e del Senato statunitensi per rispondere dello scandalo della fuga di dati.

Zuckerberg in quell'occasione, di fronte a una platea che non si può definire (con un eufemismo) di "esperti", ammise che la diffusione di fake news, i discorsi carichi d'odio (hate speech), la privacy dei dati e l'interferenza di Paesi stranieri nelle elezioni erano problemi che Facebook aveva sottovalutato.

Mark Zuckerberg di fronte ai membri del Congresso difende Facebook in merito allo scandalo della fuga di dati. Fonte: The Guardian

In un documento pubblicato a fine aprile dell'anno scorso, Facebook dichiarava sì la cancellazione di migliaia di profili falsi, ma al contempo non smentiva un altro report pubblicato dall'Office of the Director of National Intelligence, secondo cui la Russia avrebbe influenzato l'esito della campagna elettorale statunitense attraverso un'azione di propaganda compiuta strategicamente tramite falsi account.

Ma è possibile oggi quantificare in modo esatto queste “interferenze” sul voto degli elettori?

Stando alle dichiarazioni di Alexander Nix, allora amministratore delegato di CA, la campagna da lui curata negli Stati Uniti avrebbe contribuito con uno spostamento di voti quantificabile tra il 2% e il 5%. Dato verosimile o ennesima operazione di auto-promozione?

L'anno scorso un lavoro pubblicato su Science aveva analizzato i percorsi di diffusione di circa 126.000 storie (classificate come vere o false con un'attendibilità maggiore del 95%) pubblicate su Twitter dal 2006 al 2017 da circa 3 milioni di persone per oltre 4,5 milioni di volte.

I risultati mostravano che una notizia falsa ha il 70% in più di probabilità di essere ritwittata di una notizia vera, qualsiasi sia l'argomento trattato (leggende urbane, affari, terrorismo, scienza, spettacolo e ambiente). Tra le notizie false, che spesso si appoggiano a sentimenti come paura e disgusto, le più efficaci risultavano proprio quelle a tema politico: viaggiano al triplo della velocità di ogni altra notizia falsa e raggiungono il doppio delle persone.

Due nuovi paper pubblicati questo mese provano invece a quantificare il numero di utenti che ha direttamente interagito online con le fake news durante le presidenziali del 2016. Stando a questi risultati l'impatto delle notizie false sarebbe stato trascurabile.

Gli autori del lavoro diretto da David Lazer (Northeastern e Harvard University) e pubblicato su Science il 25 gennaio, hanno stilato una lista di editori che volontariamente pubblicano fake news (come ad esempio The Gateway Pundit) e hanno analizzato i tweet di 16.442 elettori registrati (un campione selezionato per rappresentare l'intero elettorato statunitense).

Lo studio ha trovato che solo lo 0,1% dei 16.000 e più elettori ha condiviso più dell'80% delle fake news generate da questi siti e che solo sull'1,1% delle bacheche di questi elettori appariva l'80% di queste fake news. I ricercatori hanno anche riscontrato che gli elettori più anziani e di orientamento conservatore sono maggiormente inclini a interagire con questo genere di notizie.

L'altro studio, diretto da Joshua Tucker (New York University) pubblicato su Science Advances il 9 gennaio, analizzando dati del social network di Zuckerberg, giunge a conclusioni simili, partendo da premesse simili.

Ma proprio le premesse di questi lavori meritano di essere approfondite. “Gli autori definiscono fake news 'la mancata applicazione di norme e procedure editoriali da parte dei media per assicurare la correttezza e la credibilità dell'informazione'” commenta, in riferimento al lavoro di David Lazer, Walter Quattrociocchi, direttore del laboratorio di Data science and complexity dell'università di Ca' Foscari, Venezia. “L'attribuzione di falsità viene effettuata a livello dell'editore e non della storia in sé”. Con una simile scelta viene ristretta fortemente la categoria di informazioni che possono rientrare nella definizione e “vengono lasciate fuori le informazioni poco accurate, quelle sensazionalistiche che innescano una reazione emotiva e gli strumenti utilizzati nella comunicazione di propaganda”.

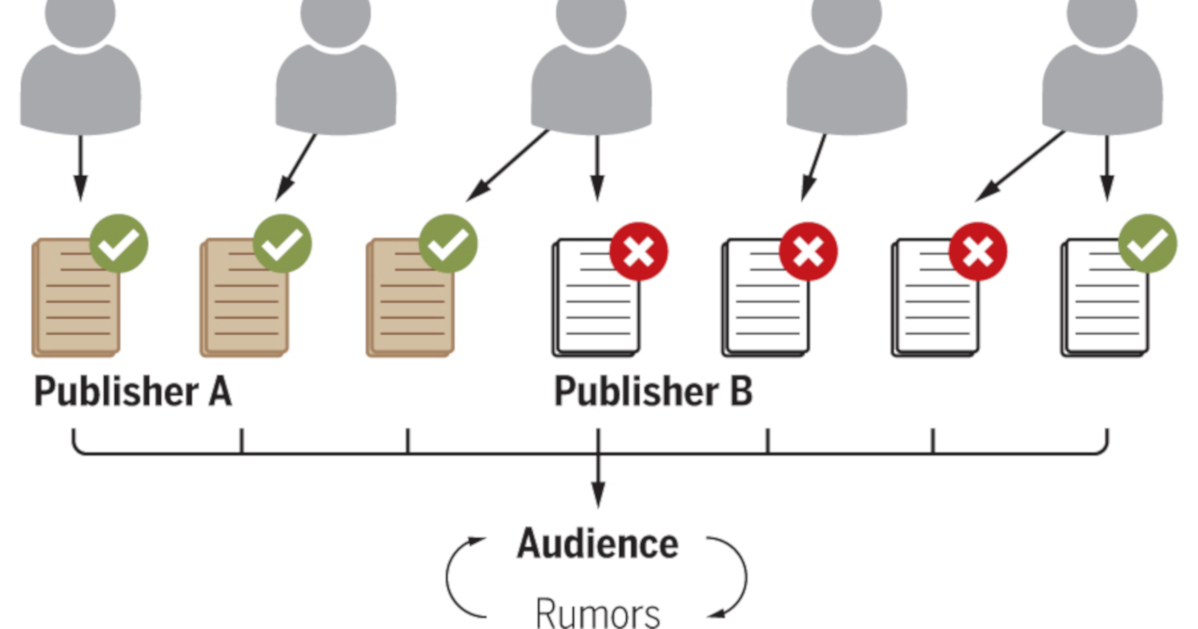

Secondo Derek Ruths (computer scientist della McGill University di Montreal), in un commento su Science, lavori che ottengono risultati apparentemente contraddittori studiano probabilmente fenomeni che avvengono a livelli diversi e complementari tra loro. Esistono infatti sia le storie che sono false in varie tonalità di grigio, sia gli editori che non rispettano le norme e le procedure del buon giornalista. La macchina della disinformazione è complessa e il fenomeno delle fake news va inserito in un ampio processo di fruizione dell'informazione che coinvolge almeno cinque passaggi: gli editori, gli autori, gli articoli, il pubblico e le “voci di corridoio” (rumors).

Gli autori (in grigio) producono per gli editori (A e B) articoli affidabili (in verde) e non affidabili (in rosso). Il pubblico interagisce con questi e con le “voci di corridoio” (rumors). Credits: Science

Tenendo conto di questa rappresentazione è possibile tenere insieme in maniera coerente risultati apparentemente contraddittori: editori con bassi standard giornalistici producono articoli dai contenuti poco affidabili; comunità relativamente piccole interagiscono direttamente con questo genere di contenuti (come suggeriscono gli studi di Tucker e Lazer di questo mese); le notizie false e sensazionalistiche corrono più velocemente nei “corridoi”, ovvero vengono maggiormente rilanciate nei social network (come suggerisce lo studio pubblicato su Science l'anno scorso).

Se però è vera questa visione proposta da Ruths, sembra altrettanto plausibile ritenere che sia sufficiente manipolare un numero ristretto di utenti per ottenere effetti su larga scala.

Occorre tuttavia notare che il modello proposto da Ruths relega ad un ruolo troppo marginale le “voci di corridoio”, ovvero quel flusso continuo di informazione non mediata da alcun editore che affolla i server dei social network e che in termini quantitativi surclassa la produzione di qualsiasi testata giornalistica.

“Analizzando le dinamiche di fruizione dell'informazione online” prosegue Quattrociocchi, che su queste tematiche ha pubblicato alcuni degli studi più influenti degli anni recenti “abbiamo capito che il problema non sono le fake news da sole, ma la polarizzazione” ovvero l'incomunicabilità tra utenti che sposano visioni opposte. È su questo substrato che le informazioni si adagiano. “La diffusione di disinformazione online (misinformation) segue regole molto semplici e strettamente legate alla polarizzazione. Gli utenti sono esposti a un'enorme quantità di informazione e senza badare al valore di verità della stessa (vera o falsa) selezionano quella che meglio si adatta al loro pre-esistente sistema di credenze (pregiudizio di conferma o confirmation bias) e così facendo si chiudono nelle echo chambers. Il debunking risulta inefficace e il fact-checking raggiunge solo coloro che scelgono di interagirci. Questo è il pattern dominante nella fruizione di informazione nei social media. Se vogliamo preoccuparci di qualcosa, dobbiamo preoccuparci della polarizzazione”.

Uno studio pubblicato a febbraio 2018 infatti mostra che è la polarizzazione il terreno di coltura più fertile per le fake news: gli argomenti più divisivi sono anche quelli più facilmente soggetti a distorsioni. Secondo Quattrociocchi il problema è a monte e la priorità è agire sulle strategie di comunicazione che mirano a ridurre le distanze. “In un'era di sfiducia diffusa dobbiamo concentrarci su quelle strategie di comunicazione capaci di ridurre la polarizzazione online”.