Fake people, cosa sono e perché vanno tenute d'occhio

“Su internet, nessuno sa che sei un cane”. La vignetta è del 1993 ma fa ancora ridere, anzi forse oggi fa ridere più che allora. Su internet nessuno può essere certo di come sia fatto davvero il tizio con cui sta chattando in segreto, né come si chiami in realtà la persona con cui sta litigando su Facebook. Eppure tutti continuiamo a farlo. E tutti (o quasi) abbiamo profili fake con cui fare cose di nascosto, come chattare con sconosciuti mascherando il nostro vero aspetto o litigare con estranei sotto pseudonimo. Eppure nessuno ce lo aveva mai spiegato così bene come Viola Bachini e Maurizio Tesconi.

I due sono, rispettivamente, giornalista scientifica e ricercatore dell’Istituto di Informatica e Telematica del CNR di Pisa, e nel loro Fake People uscito per i tipi di Codice edizioni spiegano per filo e per segno che cosa sono le persone finte che incontriamo tutti i giorni e perché vanno tenute d’occhio.

Il tema, in fondo, è sempre quello del fake che gira in rete. La differenza è che mentre di fake news abbiamo parlato fino alla nausea sentendoci tutti un po’ esperti, di fake people parlate praticamente solo voi. È un fenomeno legato alla comparsa dei social network o, come le fake news, le fake people sono sempre esistite solo che non ce n’eravamo ancora accorti?

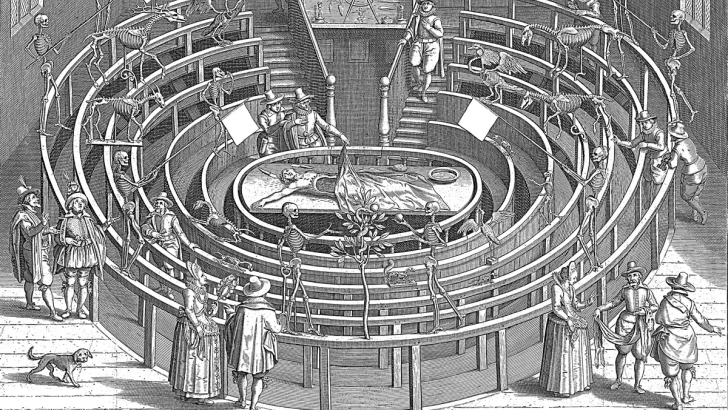

In generale, le false identità non sono un fenomeno recente, né riguardano solo Internet e i social network. Sono state utilizzate nella storia da scrittori, poeti, dissidenti e attivisti. Basti pensare a Lewis Carroll, il cui vero nome era Charles Lutwidge Dodgson, che preferì utilizzare lo pseudonimo per le sue opere di narrativa affinché il suo nome reale restasse legato al suo lavoro di professore di matematica. Anche la scrittrice Mary Ann Evans utilizzò il suo noto pseudonimo maschile George Eliot per cercare di superare gli stereotipi femminili dell’epoca. Naturalmente con l’avvento di internet e dei social network il fenomeno ha assunto una dimensione molto più vasta.

Per esempio, una delle identità anonime più famose su Internet è quella di Satoshi Nakamoto, l’inventore del BitCoin, sulla cui vera identità circolano da anni moltissime teorie e supposizioni. Cioè: su internet le false identità e l’anonimato possono aiutare gli hacktivisti a combattere i regimi, ma possono essere utilizzate anche per organizzare colossali truffe. Il solo fatto che si possano poi comandare eserciti fatti da tanti finti profili, che possono agire in modo sincronizzato, apre scenari che prima non erano neppure immaginabili.

Ecco. Sono sempre esistite ma oggi grazie alla rete possono fare cose grandiose, o pericolosissime. Ma perché rappresenterebbero un rischio concreto per tutti noi?

Il rischio è molto concreto, perché quello che la cronaca ci insegna è che gli altri utenti delle piattaforme, quelli veri, molto spesso non si accorgono di aver di fronte un falso. C’è uno studio che dimostra che le persone non sono in grado di riconoscere se sono di fronte a un loro simile o a una macchina. Tra i bot più evoluti (quelli più sofisticati, più simili agli umani), le persone sono in grado di riconoscerne solo uno su quattro. E spesso gli account falsi vengono utilizzati per compiere truffe (pensiamo per esempio alla finanza, dove il valore di un’azienda può essere gonfiato artificialmente grazie a tweet - falsi - che ne esaltano la solidità).

Per quanto riguarda l’inquinamento del dibattito social, neppure i ricercatori sono ancora riusciti a misurare l’impatto dei falsi profili, ma se si dispone di un esercito di marionette che postano contenuti su nostro comando, possiamo facilmente far entrare un hashtag nei trending topic. Queste liste degli argomenti più chiacchierati sui social vengono spesso lette dai giornalisti, che certe volte prendono ispirazione da lì per proporre un nuovo articolo o decidere quale ospite invitare in una trasmissione. Ecco che, grazie ai bot, si può portare un determinato argomento su altri media più seguiti di Twitter (per esempio in tv o sui giornali). Questo durante una campagna elettorale può essere cruciale, visto che certi temi divisivi (si pensi all’ambiente o all’immigrazione) possono avvantaggiare una certa parte politica per il solo fatto che se ne parli.

Potete menzionare casi in cui situazioni economiche o politiche sono già state manipolate con l'uso di bot? E che cosa potrà peggiorare in futuro?

Tra le storie di impiego di bot in campagna elettorale, una delle più curiose è quella che riguarda l’utilizzo di un bot Tinder da parte dei laburisti per le elezioni generali del 2017 in Inghilterra.

Per coinvolgere i giovani e convincerli a votare per il proprio partito, due giovani attiviste laburiste avevano fatto sviluppare un bot Tinder che agganciava utenti ignari attraverso profili reali messi a disposizione da attivisti del partito. Celandosi dietro alla loro foto, il programma cercava il match. Poi cominciava a conversare, entrando fin dalle prime battute nell’argomento delle imminenti elezioni e chiedeva “per chi voterai?” E, a seconda della risposte, cercava di convincere di votare laburista, postando le promesse letterali focalizzate sulla fascia di età dell’utente.

Invece la storia più famosa è quella della fabbrica di troll, un’organizzazione con sede in Russia che ha contribuito a inquinare il dibattito pubblico sulle presidenziali americane del 2016. Un gruppo di ricercatori della University of Southern California aveva scoperto che questa organizzazione si serviva di social bot molto semplici, in grado soprattutto di ritwittare alcune frasi in modo ossessivo. Gli studiosi hanno poi ripetuto la stessa ricerca per le elezioni di midterm del 2018, trovando risultati molto differenti. In particolare, sembra che i bot, pur sempre presenti sulla scena, siano profondamente cambiati. Sono diventati più sofisticati, più bravi a mimetizzarsi in mezzo alle persone reali. Questo fa pensare che, se vogliamo evitare rischi di contaminazione del dibattito pubblico sui social, in futuro ci sarà sempre più bisogno di persone specializzate nell’individuazione di questi falsi account, oltre a una maggiore attenzione e controllo da parte delle stesse piattaforme.

Parliamo invece dei video deep fake: è vero che sono facili da fare? E non possiamo pensare che diventino altrettanto facili da riconoscere, man mano che verranno perfezionati?

Il deepfake, grazie all’intelligenza artificiale, riesce a produrre media (audio, video, foto) falsi ma estremamente realistici, credibili. Al momento per produrre un video deepfake di qualità bisogna saper programmare (o almeno saper utilizzare tool non proprio intuitivi), possedere un computer abbastanza potente ed essere disposti a investire così il proprio tempo, visto che l’elaborazione richiede molte più ore rispetto a quella di un video tradizionale.

La tecnica però è molto nuova (esiste solo da un paio di anni) e sempre più popolare. È molto probabile che nel giro di poco tempo nascano nuove interfacce semplici, utilizzabili da chiunque, anche da chi non ha competenze tecniche.

Come succede spesso in informatica, anche su questa tecnica è in corso una vera e propria corsa agli armamenti: da un lato i produttori di media deepfake, che con il tempo affinano i propri algoritmi per sfornare media sempre più indistinguibili dagli originali, dall’altro piattaforme social, governi e ricercatori, che hanno tutto l’interesse a smascherarli e mettono a punto tecniche sempre più efficaci. Difficile dire adesso come andrà a finire.

Ecco, però quando in Italia è emerso che alcuni politici hanno falsi follower sui social non c’è stato nessun grosso scandalo né questi politici hanno perso voti. È perché non abbiamo ancora capito la gravità della cosa?

Se i falsi follower si limitano a gonfiare il numero di seguaci di un politico, senza postare contenuti o interagire con gli altri utenti, è giusto che la notizia non crei grosso scandalo. Una cosa sono i tentativi di manipolare il dibattito pubblico (come è successo negli Stati Uniti nel 2016), un’altra sono i fake follower che hanno attività di zombie digitali. Questi spesso sono creati con altri scopi (per esempio marketing) e seguono alcuni personaggi famosi solo per assomigliare agli altri utenti reali, che in genere seguono almeno un paio di politici. È fisiologico che un profilo datato, specialmente se appartiene a un vip, abbia alcuni follower falsi, pur non avendone mai desiderati né acquistati.

Il fenomeno dei fake follower dovrebbe invece fare scandalo in un altro mondo, quello degli influencer. Lì sì che il numero dei seguaci fa la differenza e gonfiare artificialmente il proprio seguito, acquistando migliaia di social bot, produce un danno economico. Si stima che nel 2019 il falso marketing degli influencer sia costato agli inserzionisti 1,3 miliardi di dollari. In pratica, le aziende pagano qualcuno per far raggiungere una certa visibilità ai propri prodotti, mentre la visibilità reale raggiunta è molto minore.

Come si studiano le cose di cui parlate nel libro? Non basta l'informatica, sembrerebbe.

Risponde Maurizio: Per studiare i social network è fondamentale lavorare insieme ad altri colleghi, in team multidisciplinari. L’uso dei social bot durante le elezioni politiche, ad esempio, ha un impatto a livello sociale che possiamo provare a comprendere meglio grazie al fatto che il gruppo di studio sia composto da informatici e scienziati politici. Per questo motivo a Pisa è nato il MediaLab, con un team di ricerca interdisciplinare che ha lo scopo di studiare la comunicazione sui social media durante le elezioni politiche.

Anche quando abbiamo studiato l’uso dei bot in ambito finanziario ci siamo uniti ad esperti di finanza per comprendere a fondo come è possibile influenzare gli algoritmi che investono in borsa.

E come ci si difende?

Dipende dal falso profilo. Ci sono profili falsi automatici molto semplici, con un nome composto da una sequenza di lettere e numeri casuali, nessuna foto profilo e con pochissimi o addirittura nessun follower. Si tratta di profili creati in poco tempo, e che in genere gli aspiranti influencer acquistano per pochi euro in pacchetti da migliaia di profili, e che servono solo ad aumentare il proprio numero di seguaci. Riconoscere questi profili falsi è semplice, e chiunque abbia un minimo di dimestichezza con i social intuisce facilmente che profili senza foto né nome, che twittano solo frasi generiche o citazioni, e che magari sono geolocalizzati in paesi del mondo che poco hanno a che vedere con noi, probabilmente non corrispondono a persone reali.

Ma ci sono anche falsi molto più sofisticati, con profili curati e che magari sfruttano l’intelligenza artificiale per interagire come se fossero persone a tutti gli effetti. Spesso per una persona è difficile individuarli, ma qui ci vengono in soccorso i ricercatori, i cacciatori di bot che inventano algoritmi in grado di identificare in modo automatico, e quindi rapido, anche tanti account fake in un colpo solo.

Infine... venendo a voi. Siete certi di avere solo amici reali su Facebook?

Risponde Viola: Durante la scrittura del capitolo sulle tecniche di individuazione dei bot, mi sono divertita a testare qualche algoritmo sui miei profili. Mi sono accorta che le tecniche meno sofisticate hanno un grado di accuratezza davvero basso, visto che mi hanno segnalato come falsi profili di persone che so essere autentiche, per il solo fatto che queste fossero geolocalizzate in Africa o che non postassero nulla da un po’.

E poi, sì, nonostante non li abbia mai comprati, qualche fake follower pare che ce l’abbia anch’io, come tutti, probabilmente compreso chi sta leggendo!